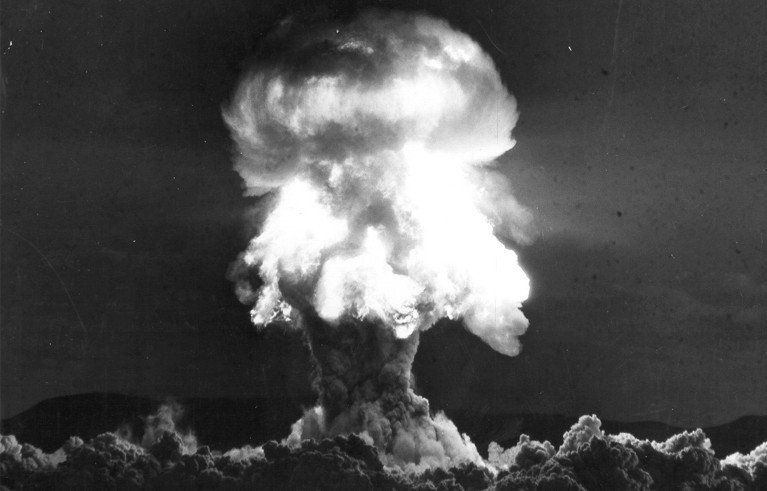

Профессор Бухарестского университета Драгош Пауль Алигикэ сравнил искусственный интеллект с атомной бомбой 1940–50-х годов. По его словам, тот, кто первым сделает решающий шаг в ИИ, получит преимущество, которое уже невозможно будет наверстать. Аналогия звучит тревожно — но за ней стоит серьёзная академическая дискуссия.

Что сказал Алигикэ

В эфире программы «Idei în nocturnă» на Radio România Cultural профессор заявил: человечество находится в ситуации беспрецедентной неопределённости. Поводом для выступления стало создание Совета по этике искусственного интеллекта при Американском институте предпринимательства (AEI) в Вашингтоне — Алигикэ участвовал в событии лично.

«Искусственный интеллект сейчас — это эквивалент атомной бомбы 1940–50-х годов. Кто делает первый шаг — получает преимущество над остальными» («Inteligența artificială este în momentul de față echivalentul bombei atomice din anii ’40-’50. Cine face prima mișcare acolo are un avantaj asupra celorlalți»)

Драгош Пауль Алигикэ, профессор Бухарестского университета

Но между ядерной гонкой и гонкой за ИИ есть ключевое отличие. В случае с бомбой отстающие могли наверстать упущенное — СССР создал своё оружие вслед за США. В случае с ИИ, по мнению учёного, это может оказаться невозможным. Кто первым достигнет критического порога — станет недосягаем.

Алигикэ подчеркнул: впервые за всю историю человечеству предстоит сосуществовать с формой интеллекта, превосходящей его собственную.

«Впервые в истории этой планеты человечеству придётся сосуществовать с формой интеллекта, превосходящей его. Никогда в истории низшая форма интеллекта не контролировала высшую — и не особенно преуспевала в отношениях с высшей» («Pentru prima dată în istoria acestei planete, umanitatea va trebui să coexiste cu o formă de inteligență superioară ei»)

Драгош Пауль Алигикэ, Radio România Cultural

Кто стоит за этими словами

Алигикэ — не блогер и не футуролог. Он доктор наук четырёх университетов, старший научный сотрудник программы Ф. А. Хайека в Университете Джорджа Мейсона (США), член-корреспондент Румынской академии и член Academia Europaea. Автор 12 книг и свыше 100 статей, опубликованных Oxford University Press и Cambridge University Press. Его вуз — Бухарестский университет — недавно укрепил позиции в международных рейтингах, что подчёркивает значимость академической базы, на которую опирается профессор.

Ещё в апреле 2025 года он предупреждал в румынской прессе: модель GPT-4.5 от OpenAI прошла тест Тьюринга — в исследовании Калифорнийского университета Сан-Диего 284 участника не смогли отличить ИИ от живого человека в 73% случаев. Тогда профессор говорил о «метаисторической бифуркации»: часть общества деградирует под влиянием информационных потоков, а другая — вынуждена заново осмыслять фундаментальные вопросы философии.

Кто такой Драгош Пауль Алигикэ

Профессор Бухарестского университета (кафедра KPMG по управлению). Старший научный сотрудник Университета Джорджа Мейсона (США). Член Academia Europaea (с 2023 г.) и член-корреспондент Румынской академии. Специализация — институциональный анализ, политическая экономия, философия управления. 12 книг и более 100 статей.

Почему аналогия с бомбой — не просто метафора

Сравнение ИИ с ядерным оружием — не изобретение Алигикэ. Генсек ООН Антониу Гутерриш предлагал создать аналог МАГАТЭ для ИИ. Глава OpenAI Сэм Альтман говорил о регуляторе по модели Комиссии по ядерному регулированию. Уоррен Баффет и Илон Маск публично предупреждали о рисках.

Однако аналитики Bulletin of the Atomic Scientists предупреждают: различий больше, чем сходств. Ядерные технологии имеют чёткую границу между мирным и военным применением — у ИИ такой границы нет. Та же система, что помогает синтезировать лекарства, способна помочь создать нейротоксин. И масштаб разработки совершенно иной: ядерным оружием владеют девять государств, а в 2023 году 51 значимую модель ИИ создали частные компании — и лишь две были государственными. Эта проблема хорошо иллюстрируется тем, что мир фактически остался без действующих механизмов ядерного контроля — а для ИИ таких механизмов не существовало изначально.

Журнал Nature в 2025 году указал на ещё одну грань: ИИ и дезинформация вместе усиливают риск ядерного конфликта. Военные по всему миру уже используют ИИ для анализа разведданных и систем раннего предупреждения. Скорость решений растёт — а вместе с ней и цена ошибки в мире с 12 тысячами боеголовок. После истечения договора СНВ-3 баланс сдерживания стал ещё более хрупким, и появление ИИ в цепочке принятия военных решений добавляет к этому новый фактор неопределённости.

Что предлагают эксперты

Вместо попыток «заморозить» развитие ИИ учёные призывают сосредоточиться на нормах ответственного поведения: обязательная оценка рисков перед запуском новых моделей, ограничения на использование ИИ в информационных операциях и международный диалог — прежде всего между США и Китаем. Тема информационных угроз особенно актуальна: Румыния уже запустила кампанию против ИИ-дезинформации, а премьер Греции назвал сочетание фейков и ИИ «взрывным коктейлем» для демократии.

Алигикэ, в свою очередь, настаивает на принципе предосторожности: в условиях неопределённости нельзя «бросаться головой вперёд». Нужно перевести как можно больше неизвестного в категорию просчитанного риска — и только потом действовать.

Источники

Материал подготовлен на основе анализа публикаций:

1. «Dragoș Paul Aligică: Inteligența Artificială este echivalentul bombei atomice din anii ’40-’50» — Radio România Cultural • Румыния • 25 марта 2026 | Ссылка ➚

2. «Prof. dr. Dragoș Aligică trage un semnal de alarmă: AI a trecut testul Turing» — Gândul, Oana Zvobodă • Румыния • 20 апреля 2025 | Ссылка ➚

3. «AI devine tot mai periculoasă pentru oameni» — Evenimentul Zilei, Iulia Moise • Румыния • 20 апреля 2025 | Ссылка ➚

4. «AI and the A-bomb: What the analogy captures and misses» — Bulletin of the Atomic Scientists, Kevin Klyman, Raphael Piliero • США • 9 сентября 2024 | Ссылка ➚

5. «AI and misinformation are supercharging the risk of nuclear war» — Nature • Великобритания • 17 июля 2025 | Ссылка ➚

Данный материал представляет собой обобщение информации из указанных источников. Редакция Smorodina.news стремится к максимальной точности, но рекомендует обращаться к оригинальным публикациям для получения полной картины событий.

© 2026 Smorodina.news. Материал предоставлен в соответствии с принципами добросовестного использования (Fair Use) исключительно в информационных целях.